Как искусственный интеллект видит мир?

Десятилетиями исследователи задавались этим вопросом, но в последнее время он стал особенно актуален, ведь системы машинного зрения играют все большую роль в нашей жизни, от медицины до машин-беспилотников. Нам сложно понять, почему искин в одном человеке опознает пешехода, а другого принимает за фонарный столб. И вот эта неспособность понять «почему?» может нам дорого обойтись и даже стоить жизней, как показали аварии с самоуправляемыми машинами, в которых погибли люди.

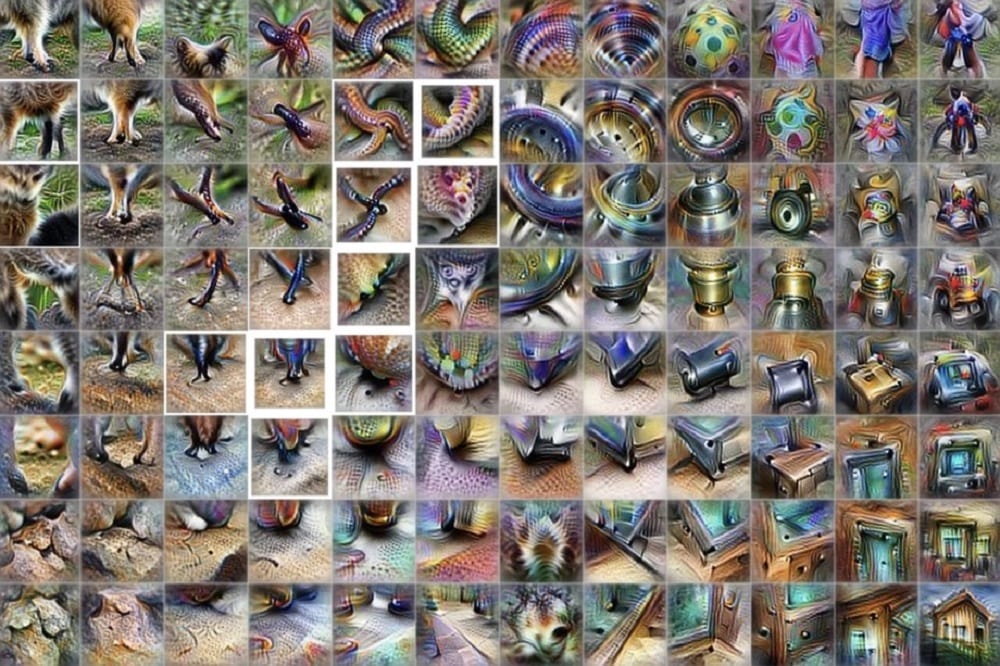

Новое исследование Google и некоммерческой лаборатории OpenAI надеется пролить свет на эту тайну, создавая карты визуальных данных, которые такие системы используют, чтобы ориентироваться в окружающем мире. Метод под названием «Activation Atlases» позволяет исследователям увидеть работу алгоритмов, показывая не только абстрактные формы, которые воспринимает искин, но и то, как он комбинирует эти элементы, чтобы распознавать предметы, животных и местность.

Вот тут можно рассмотреть «начинку» нейронной сети под названием GoogLeNet или InceptionV1.

Разные части этой карты показывают, как нейронная сеть «видит» различные понятия, и как она их связывает между собой (например, все собаки собраны в одном месте, а все птицы – в другом). Нижние уровни более абстрактны и содержат основные геометрические формы, тогда как более высокие уровни собирают из них узнаваемые образы.

Скептик увидит в такой демонстрации ограниченность машинного зрения, ведь, как бы ни были эффективны такие алгоритмы, эта информация не имеет ничего общего с человеческим восприятием мира, что делает их уязвимыми. Например, если поместить на изображение несколько пикселей в стратегических местах, алгоритм собьется и неправильно классифицирует его. Но с другой стороны, «Activation Atlases» открывает для нас поразительную глубину и гибкость машинного восприятия.

/cdn.vox-cdn.com/uploads/chorus_asset/file/15867771/activation_atlas_zoom.gif)